Geen producten in de winkelwagen.

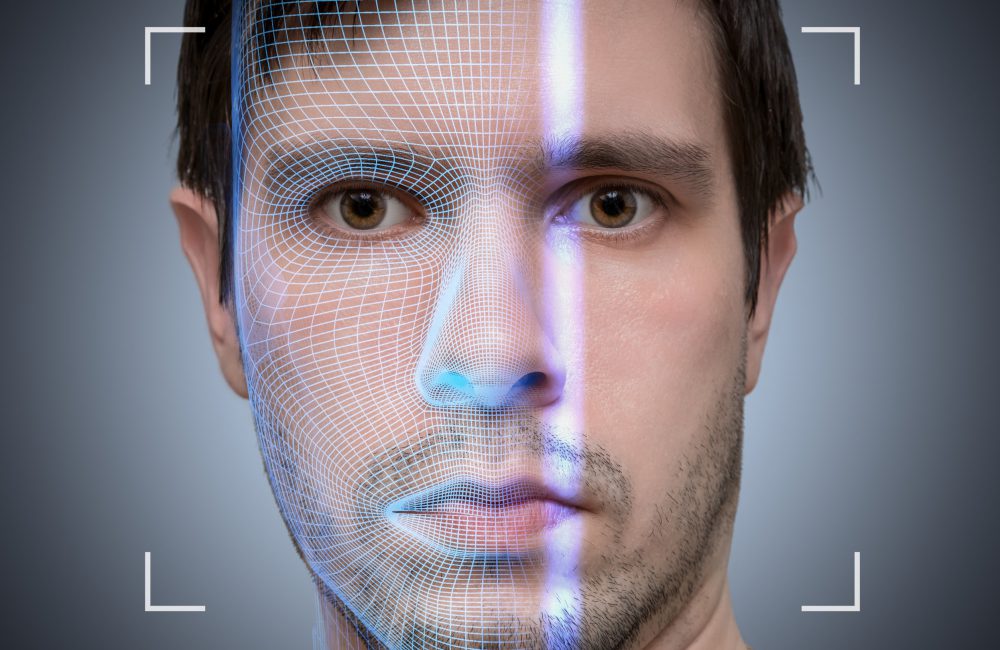

Misschien heb je er al eens van gehoord, deepfake. Deepfake is een samentrekking van twee Engelse termen. Deep learning en fake. Wat een paar jaar geleden ontstond als iets belangrijks in de technische wereld van de artificial intelligence is tegenwoordig iets wat zomaar tegen je gebruikt kan worden.

Deepfakes kunnen schadelijk zijn

Doordat computers tegenwoordig zoveel kunnen, is het steeds lastiger om echt van nep te onderscheiden. Het gaat dusdanig ver dat zelfs computers echt en nep niet meer kunnen onderscheiden van elkaar. Op een zeker punt kan dat uiteindelijk wel weer, maar deze techniek zal altijd achter lopen. Daarnaast is er een groot risico op de verspreiding van nepnieuws door middel van deepfake en kunnen er zelfs geloofwaardige oorlogsverklaringen worden uitgesproken zonder dat de desbetreffende persoon dit ooit zelf heeft gezegd.

Bekijk ook: Twitter blokkeert site met nepnieuws over coronavirus

Kunnen we onze ogen en oren online nog wel geloven?

Het is ontzettend lastig om onze ogen en oren nog écht te geloven wanneer we online bezig zijn. Je wordt binnen no-time op het verkeerde been gezet. En of het dan gaat om iets onschuldigs of juist iets ingrijpends, het is ontzettend lastig. En het gaat ook verder dan alleen online. Kunstmatige intelligentie komt steeds vaker voor in films, waardoor dingen helemaal niet zo zijn zoals ze echt zijn.

Je kunt hierbij bijvoorbeeld denken aan de Netflix-original The Irishman. In deze film speelt onder andere Robert de Niro. De Niro is, door middel van deepfake technologie, een stuk jonger gemaakt dan dat hij daadwerkelijk is. In onderstaande video zie je het verschil. Links de echte opname, rechts de verjonging.

Snapchat & kunstmatige intelligentie

Om de basisbeginselen van deepfake een beetje te leren kennen is de populaire app Snapchat een goed voorbeeld. Deze app maakt gebruik van kunstmatige intelligentie om een filter over je hoofd te plakken. De computer, of in dit geval je telefoon, weet precies wat een gezicht is en waar deze uit is opgebouwd. Hierdoor kun je filters gebruiken op je gezicht. Dit is precies hetgeen wat ook gebeurd bij deepfakes. Er wordt een masker gemaakt van het gezicht van de gefakete persoon en deze wordt vervolgens opgevuld met andere data vanuit bijvoorbeeld foto's.

Hoe gemakkelijk is het om een deepfake te maken?

Vandaag de dag is het steeds gemakkelijker om deepfakes te maken. In principe kan iedereen met een computer wel een deepfake produceren, mits je over de juiste software beschikt. Een simpele zoektocht op het internet is voldoende om geavanceerde software te vinden die het werk voor je op kan lossen.

thispersondoesnotexist.com

Een ander prachtig voorbeeld van kunstmatige intelligentie is de website thispersondoesnotexist.com. Je kunt hier foto's vinden van niet bestaande mensen. Het leuke is dat deze website constant nieuwe foto's van niet bestaande mensen laat zien, iedere keer als je de pagina vernieuwd. Maar deze personen bestaan dus helemaal niet. Ze zijn volledig bedacht door computers.

Zelf een deepfake maken? Het kan!

Er zijn verschillende applicaties op de markt, voor zowel telefoon als computer, waarmee je aan de slag kunt. Wil jij spelen in een film? Dan kan dat in principe zo geregeld worden. Hoe dat precies werkt? Dat leggen de collega's van Bright je graag even uit:

De video van Bright is inmiddels al een tijdje geleden opgenomen. Doordat er sprake is van AI en machine learning ontwikkelt de techniek zich steeds sneller en sneller. Tegenwoordig zul je dus al sneller een deepfake hebben die ook nog eens beter is van kwaliteit.

Deepnude

Het grootste gevaar, voor jou als persoon, zit in de deepnudes. Deze vorm van deepfake zorgt ervoor dat jij zomaar in een pornofilm terecht zou kunnen komen. Zonder dat je ooit op een opnamelocatie bent geweest, zonder dat het echt je bedoeling was. Dankzij de technieken is het gewoon mogelijk.

De eerste deepnudes werden tijden geleden al gemaakt van bekende actrices en verspreidt via onder andere Reddit. Nu maakt het niet meer uit of je een bekend persoon bent, ook als onbekende persoon kun je zomaar in een pornofilm terecht komen.

Beroemdheden zijn vaker de klos

De pornofilms met deepfaketechnologie zijn al langere tijd onder ons, ook in Nederland. Zo hebben onder andere Dionne Stax, Bridget Maasland en Chantal Janzen al gespeeld in een pornofilm, zonder dat ze er daadwerkelijk bij waren. De kans dat het zomaar gebeurd bij jou is dan ook niet heel groot. Op dit moment zal er namelijk een volledige 3D-scan gemaakt moeten worden van je hoofd, of zullen er dusdanig veel 2D-foto's nodig zijn om het soepel te laten verlopen.

Bekijk ook: Fake nieuws, schadelijker dan we denken

Pruts er niet teveel mee

Het verspreiden van naaktbeelden van een persoon kan gigantische gevolgen hebben. Mogelijke werkgevers die niets meer met je te maken willen hebben omdat je in een pornofilm hebt gezeten bijvoorbeeld. Zelfs al is het fake. Want heel eerlijk, je gaat je niet uitkleden op een sollicitatiegesprek om te laten zien dat jij het niet was. Ga daarom voorzichtig om met de dingen die je doet en neem de leuke kant van het verhaal met je mee.

Bekijk ook:

Thom

Thom schrijft teksten sinds de herfst van 2013. In de afgelopen jaren heeft hij tal van ervaringen opgedaan op het schrijven van teksten. Van verkoopteksten tot nieuwsartikelen en van productomschrijvingen tot beschrijvingen van applicaties.

Gevaarlijke ontwikkelingen die deepfakes